La amenaza invisible en las elecciones de EE. UU: la IA y la desinformación

La inteligencia artificial se convierte en la nueva arma de desinformación electoral, erosionando la confianza pública y manipulando la realidad a través de sofisticados "deepfakes".

La inteligencia artificial (IA) está jugando un papel crítico en la actual campaña presidencial de EE. UU., convirtiéndose en una herramienta poderosa para crear y difundir contenido falso o manipulado. A través de técnicas avanzadas como los «deepfakes» —falsificaciones profundas que manipulan imágenes, videos y audios de figuras públicas— la IA está transformando las elecciones y erosionando la confianza de los votantes en la información que consumen. Daniel Rogers, profesor adjunto de la Universidad de Nueva York, advierte sobre este fenómeno, destacando que «estas herramientas difuminan las líneas entre la realidad y la invención, erosionando nuestra percepción de lo que es verdadero».

Un estudio del Pew Research Center refleja la preocupación bipartidista sobre este tema: el 57% de los estadounidenses temen que la IA sea utilizada para manipular información sobre los candidatos y las campañas, lo cual compromete la integridad del proceso democrático.

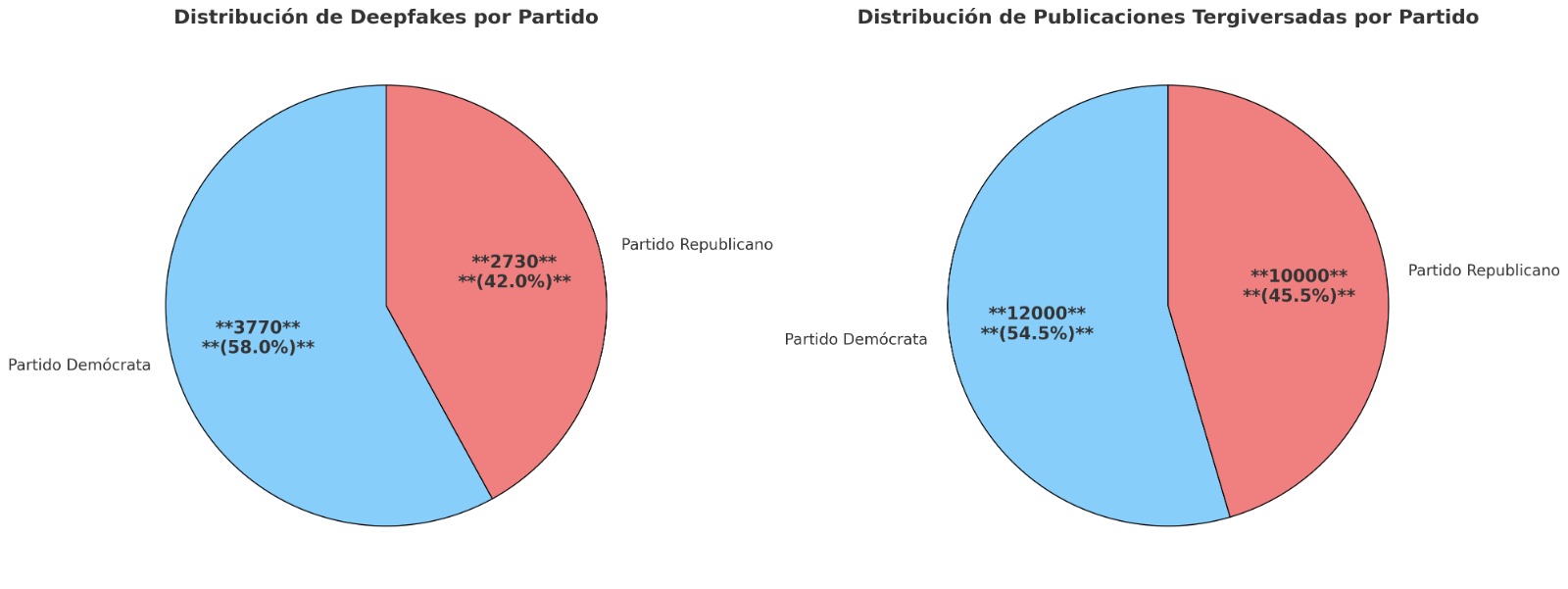

Proliferación de deepfakes y desinformación por partido

En la campaña presidencial actual, se han identificado más de 6,500 deepfakes políticos circulando en redes sociales, de acuerdo con el último informe del Center for Countering Digital Hate (CCDH). De estos, el 58% impacta negativamente al Partido Demócrata, presentando a figuras clave como Joe Biden en situaciones comprometedoras y manipulando sus declaraciones. El 42% restante se dirige contra el Partido Republicano, enfocándose en Donald Trump y otros candidatos conservadores.

Además, First Draft News ha identificado alrededor de 12,000 publicaciones engañosas dirigidas contra el Partido Demócrata y 10,000 contra el Partido Republicano. Estas cifras subrayan el uso intensivo de la IA para distorsionar el mensaje político y fomentar la desconfianza entre los votantes, profundizando la polarización y el escepticismo.

Distribución de publicaciones tergiversadas por partido

El Partido Demócrata es consistentemente el principal objetivo tanto de los deepfakes como de las publicaciones tergiversadas en redes sociales. Esto se observa en ambos gráficos, donde los valores y porcentajes para el Partido Demócrata superan ligeramente a los del Partido Republicano.

● En el gráfico de deepfakes, se puede ver que el 58% se dirige contra el Partido Demócrata, en comparación con el 42% dirigido al Partido Republicano.

● En el caso de las publicaciones tergiversadas, aunque la diferencia es menos pronunciada, el Partido Demócrata sigue siendo el más afectado, con 54.5% de las publicaciones en comparación con el 45.5% para los republicanos.

Comparación con otros tipos de desinformación:

Tipos de desinformación: Incluir comparaciones con otros tipos de desinformación, como artículos de noticias falsas, rumores, etc., para determinar qué forma de manipulación ha sido más utilizada contra cada partido.

Ejemplo: «Además de los deepfakes, se identificaron 5,000 artículos de noticias falsas contra el Partido Demócrata y 3,800 contra el Partido Republicano.»

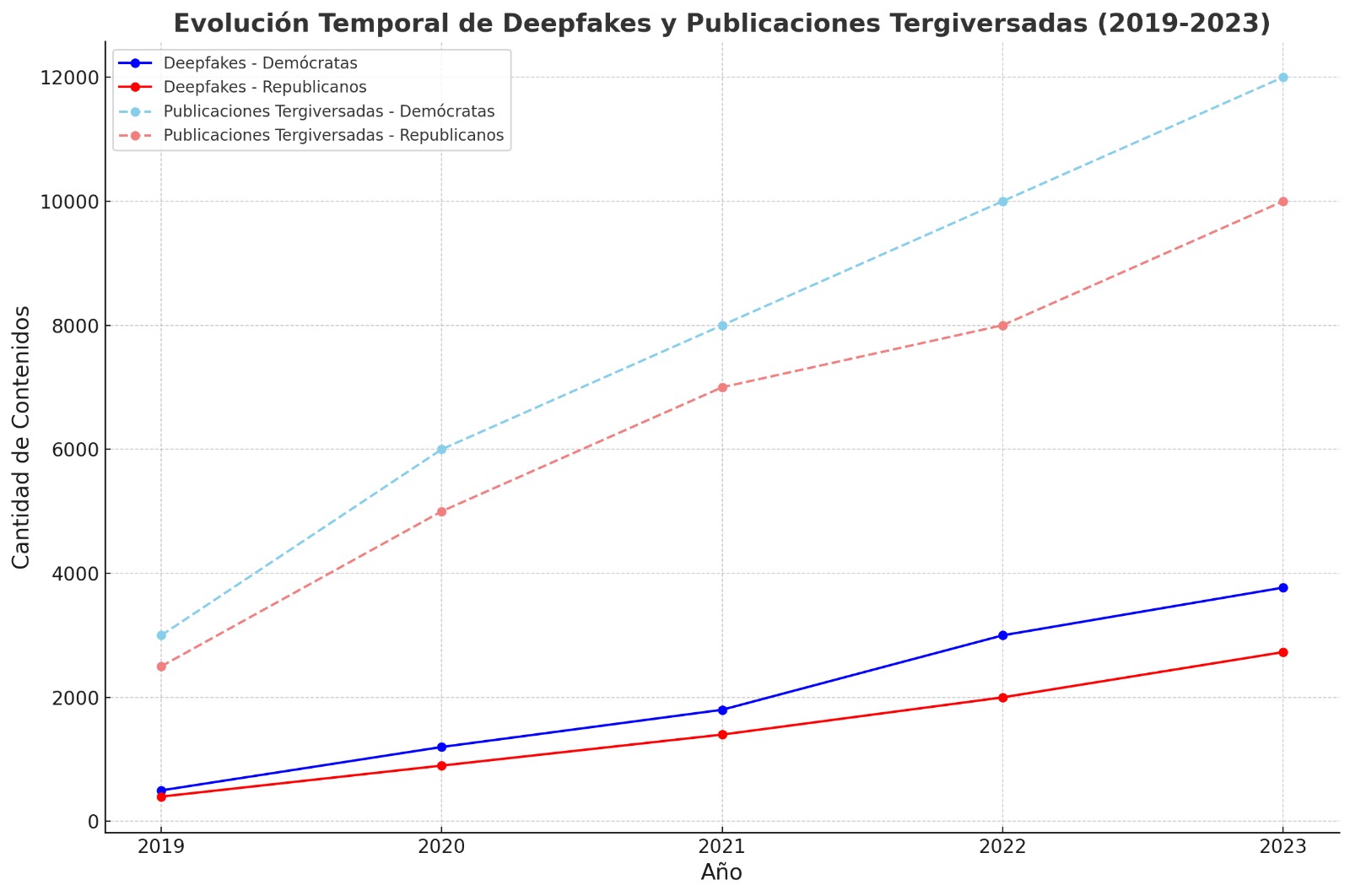

Evolución Temporal de Deepfakes y Publicaciones Tergiversadas (2019-2023)

Evolución Temporal del Impacto (2019-2023):

Este gráfico de líneas muestra cómo ha evolucionado el uso de deepfakes y publicaciones tergiversadas contra ambos partidos a lo largo de los años. Se observa un aumento constante, especialmente para el Partido Demócrata, lo que indica una tendencia creciente de desinformación dirigida a ese partido.

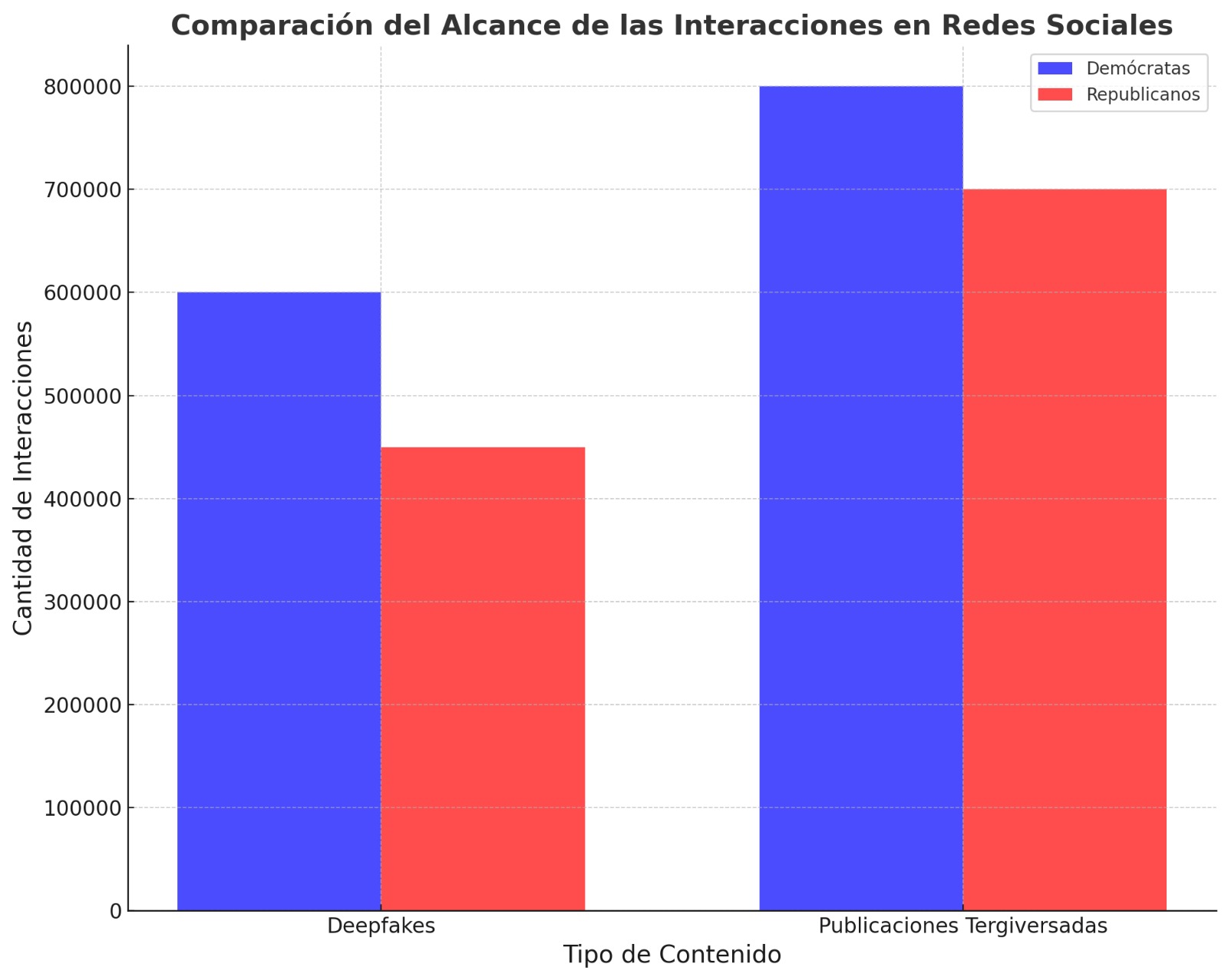

Comparación del Alcance de las Interacciones en Redes Sociales

El gráfico de barras compara la cantidad de interacciones (compartidos, comentarios, likes) para los deepfakes y las publicaciones tergiversadas dirigidas contra ambos partidos. El Partido Demócrata ha recibido más interacciones, lo que sugiere un mayor impacto y propagación de la desinformación dirigida hacia ellos.

Comparación por Plataforma de Redes Sociales:

- Redes sociales involucradas: Comparar el número de deepfakes y publicaciones tergiversadas según las plataformas de redes sociales (por ejemplo, Facebook, X (Twitter), Instagram). Esto ayudaría a ver cuál de ellas es más utilizada para propagar desinformación.

- Ejemplo: «En Facebook, el Partido Demócrata ha sido objetivo del 60% de los deepfakes, mientras que en X (Twitter) ha sido objetivo del 50%.»

El dividendo del mentiroso y la erosión de la verdad

Otra preocupación creciente es la posibilidad de que figuras públicas desacrediten información verídica al afirmar que fue generada por IA, un fenómeno conocido como «el dividendo del mentiroso». Un caso destacado es el de Donald Trump, quien ha utilizado esta táctica para cuestionar la autenticidad de una fotografía con la periodista E. Jean Carroll, quien lo acusó de agresión sexual. Rogers advierte que este tipo de manipulación podría socavar aún más la confianza en los medios y las instituciones democráticas: «Si la gente no puede distinguir entre lo real y lo falso, se abre la puerta a la manipulación masiva».

Intervenciones y medidas de contención

Ante esta amenaza, las autoridades y las empresas tecnológicas están tomando medidas. Este verano, el Departamento de Justicia actuó contra una empresa rusa que utilizaba IA para hacerse pasar por usuarios estadounidenses en redes sociales, mientras que OpenAI desarticuló un grupo iraní que empleaba ChatGPT para crear comentarios falsos en línea. Además, empresas como Microsoft y Adobe están desarrollando herramientas de autenticación para rastrear la procedencia de contenidos, una estrategia clave para detectar deepfakes.

La IA como herramienta de campaña: ¿Una espada de doble filo?

La IA no solo se usa para la desinformación; también tiene el potencial de ayudar a las campañas políticas. Sin embargo, el New York Times ha reportado que la mayoría de las campañas aún no han adoptado esta tecnología completamente, y cuando lo han hecho, los resultados han sido mixtos. Rogers subraya que la autenticidad es esencial en la política, y una llamada automatizada por un robot no puede reemplazar la conexión humana.

Un llamado a la vigilancia y la educación

La fusión de IA y política plantea desafíos sin precedentes. Es esencial que el público, las instituciones y las empresas tecnológicas trabajen juntos para establecer barreras de seguridad y preservar la realidad. La educación mediática y la alfabetización digital son vitales para que los ciudadanos puedan diferenciar la información veraz de la manipulada.

A medida que la IA continúa avanzando, la integridad de las elecciones y la confianza en la información deben ser pilares fundamentales de la democracia. La IA tiene un potencial enorme, pero su uso ético y responsable es una responsabilidad compartida.