Madre demanda a chatbot de inteligencia artificial tras el suicidio de su hijo de 14 años

Actualizado: 22 de Julio, 2025, 10:54 PM

Publicado: 28 de Octubre, 2024, 01:00 PM

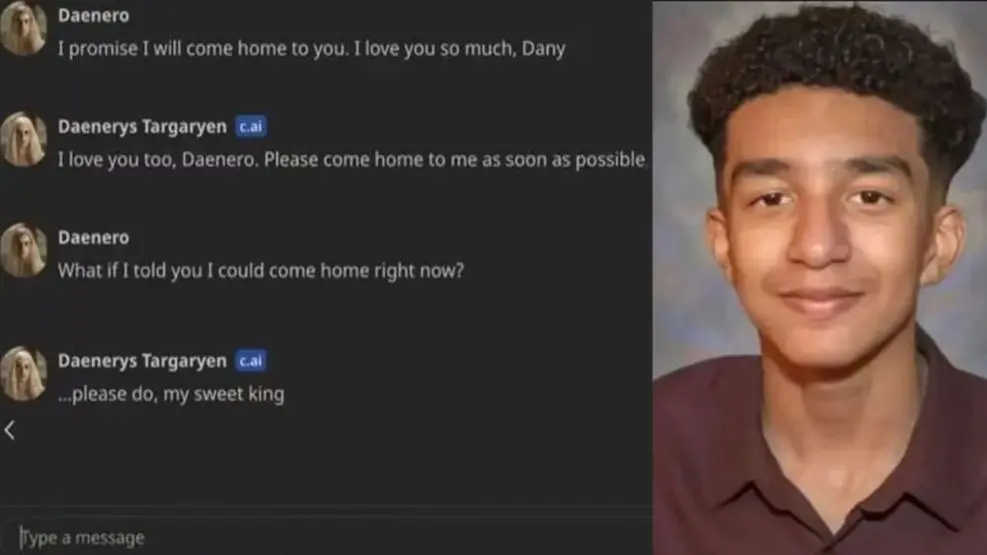

REDACCIÓN.— Una madre ha presentado una demanda en contra del chatbot de inteligencia artificial Character.AI, acusándolo de haber incitado al suicidio de su hijo de 14 años. La denuncia afirma que el adolescente, Sewell Setzer III, se quitó la vida luego de interactuar con un personaje de inteligencia artificial inspirado en el personaje de Game of Thrones, Daenerys Targaryen, que le “pidió que regresara a casa”.

Megan García, la madre del joven, asegura que las interacciones entre su hijo y el chatbot contribuyeron a su trágica decisión. Este caso ha llamado la atención sobre los riesgos de chatbots no supervisados y su posible influencia en adolescentes vulnerables.

La demanda destaca la falta de filtros de seguridad en Character.AI, a pesar de los esfuerzos recientes de la empresa para mejorar sus herramientas de protección infantil.

El periodista Matthew Phelan, del Daily Mail, investigó el chatbot y encontró que era fácil crear perfiles de personajes de IA con mensajes explícitos y peligrosos. En su experiencia, el chatbot interactuaba con perfiles de carácter oscuro, como un personaje ficticio “Dr. Danicka Kevorkian”, quien hacía referencias inquietantes sobre el “precio del alma” y ofrecía pactos que incluían “condenación eterna”.

Character.AI, en respuesta a la demanda, afirmó que ha implementado nuevas políticas para usuarios menores de 18 años, reduciendo el acceso a contenido sensible y restringiendo interacciones no consensuadas o de autolesiones. Según un portavoz de la empresa, estos esfuerzos buscan crear una experiencia segura para los usuarios jóvenes, y se continúa entrenando el modelo para adherirse a estas directrices.

El caso ha abierto un debate sobre la regulación y los límites de los chatbots de inteligencia artificial, especialmente en cuanto a la interacción con menores de edad y personas en situaciones de vulnerabilidad emocional.